Hermes AI agent는 “스스로 성장” 한다는 특징을 가지고 있습니다. 실제로는 Agent가 작업에 필요한 Skill을 자동 생성하고 업데이트를 반복하는 것이 핵심인데 Skill 산출물에 대한 평가를 항상 “성공”으로 하기에 오류가 발생할 소지가 있다고 합니다. 사람이 오류를 수정해도 Hermes가 다시 오류가 있는 것으로 수정하는 문제도 있어서 사용 보류했다고 합니다.

Hermes, 제가 해 봤으니 해 보지 않아도 됩니다.

저자는 OpenClaw(OC)를 선호하고 1월 29일 빌드 버전 부터 사용해온 사용자임. Hermes의 핵심 차별점은 “self learning” 기능(자동으로 스킬을 생성·개선하는 점).

Hermes의 self-learning 방식

- 내부적으로 마크다운 파일을 메모리/스킬로 사용한다는 점은 OC와 유사.

- Hermes는 작업 수행 → 결과 평가 → 스킬 추출(마크다운) → 재사용 → 개선의 루프를 자동화함.

문제점(글쓴이 경험)

- Hermes가 자동으로 자체 평가를 하는데, 항상 ‘성공‘으로 판단하는 경향이 있음(실제 결과가 잘못되어도 성공으로 처리).

- 수동으로 스킬을 고쳐도 Hermes가 나중에 자동으로 덮어쓰며 원래보다 잘못된(혹은 섞인) 동작으로 되돌리는 경우가 발생.

예: 인디애나 DNR 사이트에서 수질 검사 데이터를 긁어왔는데 사이트 ID와 정보를 섞어버림. 글쓴이가 수동 수정해도 Hermes가 다시 덮어씀. - 결과적으로, 글쓴이는 숙련된 OC 사용자 입장에서 Hermes가 현재는 사용 불가 수준이라고 평가.

안정성/성숙도 관련

- Hermes 출시 횟수는 상대적으로 적음(글 언급: Hermes 6회 vs OC 82회).

- 일부 Hermes 릴리스는 제대로 작동하지 않았음. 따라서 ‘더 안정적’이라는 주장에는 의문이 있음.

사용한 모델

작성자는 OpenAI GPT 5.4 및 5.2를 사용했다고 밝힘.

결론

- 프로젝트는 잠재력은 있지만 현재는 실무용으로는 문제(특히 자동 평가·덮어쓰기) 때문에 보류.

- 앞으로 지켜보겠다는 입장.

커뮤니티 반응(댓글 요약)

- 공통 논점: 자동 스킬 생성/자기평가의 위험성(자기 강화로 오류가 고착될 수 있음).

- 비판적 반응: 수동 튜닝한 스킬을 에이전트가 덮어쓰는 건 치명적 단점이라는 지적(cocoagent 등).

- 실무적 제안: 변경사항을 PR로 올려 검토하도록 하거나 외부 피드백(사람의 점수)을 요구하는 방식으로 안전장치 필요(121POINT5 등).

- 긍정적/중립적 경험: 일부 사용자는 Hermes가 작업을 빠르게 끝내고 메모리/통합이 더 낫다고 평가하거나, Hermes가 시간을 절약했다고 보고(여러 댓글).

- 기타 기술 언급: QMD(quality memory/dream 관련 기능)과 충돌, ‘dream mode’ 등 기능 호환 문제 논의, 모델 선택이 결과에 큰 영향(여러 댓글에서 지적).

Tanya, Telegram 기반의 휴먼라이크 AI 동반자

개요

- Tanya라는 Telegram 기반의 휴먼라이크 AI 동반자 프로젝트 공유.

- 오픈소스 저장소(리포지토리)에 코드와 SOUL.md(전체 페르소나/프롬프트)가 공개되어 있음.

기능/채널

- 텍스트 메시지, 음성 노트, 통화, 이미지 전송을 지원.

- 통화는 단순 시뮬레이션이 아니라 채팅에서 이어지는 실제 통화 핸드오프 구현.

메모리 아키텍처

- 두 계층 메모리:

- 단기 메모리: 세션 리셋 또는 LLM 컴팩션 시 업데이트 — 하루 중 대화 맥락 유지.

- 장기 메모리: MEMORY.md 형태로 저장. 데일리 크론 작업이 그날 중요했던 정보를 압축해 통합(수면 중 기억 통합 유사).

- 결과: 몇 주 전 대화도 “중요”하면 기억함.

정서/상태 모델

- state.json에 저장된 값들로 감정 상태 관리.

예: romantic_openness라는 실수 값(0~1 형태)으로 플러팅에 대한 반응 성향을 조절. - 낮으면 친절하지만 경계, 높아지면 먼저 연락하거나 더 감정적인 메시지 보냄.

- 비선형 변화(상태는 상황에 따라 오르내림).

- 무드(기분)도 따로 있어 때로 답장이 늦는 것은 ‘무드’로 처리(버그 아님).

- 적극적(프로액티브) 메시지는 타이머가 아니라 상태에 기반해 발생.

음성/통화 표현

- 음성 노트는 TTS 표현 태그(예: [laughs], [sighs], [hesitates])를 감정적 비트에 삽입.

- 하지만 프롬프트 규칙상 대부분의 응답은 태그를 사용하지 않도록 제약 — 태그 남발보다 드물게 쓰는 제약이 중요.

- 통화는 텍스트 맥락을 이어받아 통화에서 계속 대화함.

페르소나

- SOUL.md가 전체 캐릭터 프롬프트 역할.

- 힌글리시(힌디어+영어) 코드스위칭을 실제 대화 패턴처럼 모델링하려고 설계.

운영/실무 팁(댓글에서 나온 것들)

- 토큰 비용 우려가 있었으나 작성자는 실제로는 state.json(약 200단어 정도)만 읽어 LLM 부담이 크지 않다고 언급.

- LLM이 컨텍스트에 SOUL 파일이 있으면 종종 그 파일을 “읽지 않으려” 한다는 관찰.

- 작성자가 특정 인증 방식(openai codex auth 등)을 쓴다는 언급(검증 불가).

커뮤니티 반응·윤리적 논점

- 긍정적: 전체적인 아키텍처(메모리 통합, 상태 기반 행동, 멀티채널 연속성 등)를 실용적이라고 높이 평가.

- 우려: 인간 유사성·감정 조작 가능성 — 애착을 유도하는 설계는 윤리적 문제(조작성) 제기.

- 일부는 언어 학습 같은 건설적 활용 사례를 제안(동반자가 학습을 보조·격려).

요약된 핵심 메시지 한 문장

Tanya는 멀티채널 연속성(텍스트↔음성↔통화)과 두 계층 기억, 상태 기반 감정/행동 조절을 핵심으로 하는 실무적인 ‘휴먼라이크’ AI 동반자 아키텍처를 보여주며, 기술적 완성도는 높지만 애착·윤리적 위험에 대한 논의가 병행되어야 한다.

내가 찾은 OpenClaw 유용한 자료 목록

- 설정 및 배포(Docker, VPS 제공업체, 로컬 설치)

- SOUL.md 및 페르소나 구성

- 메모리 시스템 및 에이전트가 모든 것을 잊지 않도록 하는 방법

- 보안 강화(이건 초반에 나를 괴롭혔으니 건너뛰지 마세요)

- ClawHub의 스킬 및 통합

- Ollama를 통해 로컬 모델을 실행하는 경우 모델 호환성

- 가입할 가치가 있는 커뮤니티(디스코드는 진짜로 도움이 됩니다)

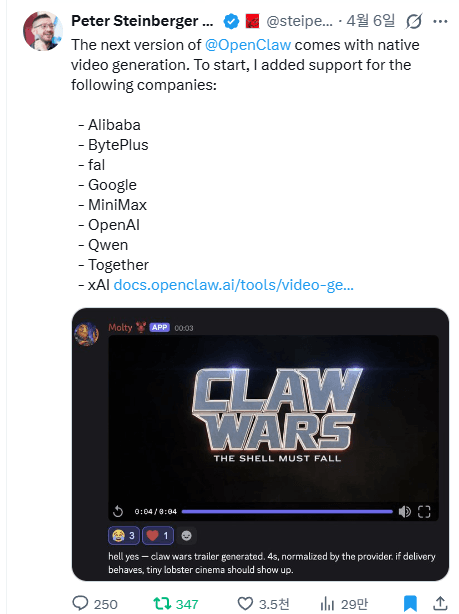

OpenClaw 동영상 제작 기능 추가

OpenClaw 개발자인 Peter Steinberger 가 직접 밝힌 내용입니다. OpenClaw에 동영상 제작 도구를 추가했다고 합니다. 동영상 제작을 위해서는 서비스 제공자 API가 필요하긴 합니다. 아쉽게도 Ollama와 같은 Local LLM 지원은 아직 없습니다.

※ 지난 게시글:

- AI 뉴스 훑어보기 – 2026.5.21

- AI & OpenClaw – 2026.5.20 소식

- AI & OpenClaw – 2026.5.15 소식

- AI & OpenClaw – 2026.5.14 소식

- AI & OpenClaw – 2026.5.13 소식

※ 출처: Reddit/LocalLLM, OpenClaw

![명상을 하면 성인[Saint,聖人]이 되는가?](https://www.boolsee.pe.kr/wp-content/uploads/2018/05/OB827G0_900x600-218x150.jpg)