RX 570 4GB에서도 Local LLM 기동이 가능했다고 합니다. Kick Starter 프로젝트로 시작한 AI 데스크탑 장비 Olares One의 성능 시험 결과를 보면 기존 DGX Spark 보다 좋아 보입니다.

4GB VRAM이 죽었다고? 56 t/s on a Polaris RX 570 with 8k Context!

오래된 RX 570 4GB, i5-9400F, CachyOS에서 최신의 llama.cpp Ubuntu build 사용해 보았다고 합니다. 소형 모델인 Gemma4-E2B-IT-Q4_K_M 이라도 사실 RTX 4060 ti 8GB 모델에서도 작성자가 얻었다는 56 TPS 나올지는 잘 모르겠습니다.

설정:

- GPU: AMD Radeon RX 570 4GB (Polaris 10)

- OS: CachyOS (Linux) using RADV drivers

- Model: gemma-4-E2B-it-Q4_K_M.gguf

- Backend: Vulkan

‘마법’ 명령:

./llama-server -m gemma-4-E2B-it-Q4_K_M.gguf --host 0.0.0.0 --port 11435 --ctx-size 8192 --n-gpu-layers 99 --threads 4 --no-warmup --reasoning off -np 2

수치:

- Context Size: 8192 (8k)

- Speed: 56 tokens/sec consistently.

- VRAM Usage: 3.6 GB total (System takes ~600MB, the model + 8k KV cache takes ~3GB).

주요 포인트: -np 2 지정은 정말 놀랍게도 4GB 제한을 유지하면서 8K context 를 문제없이 동작함.

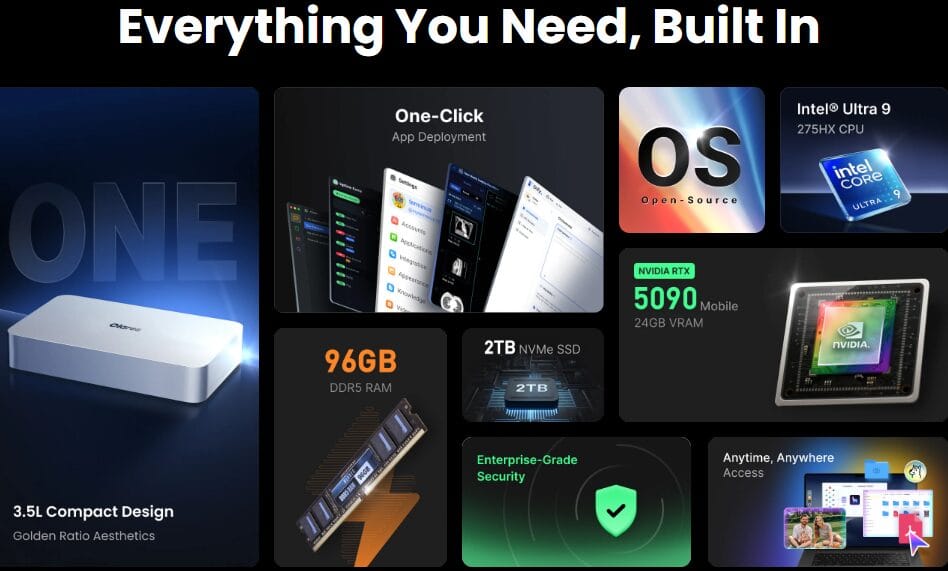

일반 Blackwell mobile 장치에서의 첫 sm_120 BeeLlama.cpp benchmark: 107 t/s at FULL 262K context on Qwen3.6 27B (+48% vs MTP, +22% vs vLLM Genesis)

Olares One과 Beellama.cpp 이용한 성능 시험 결과입니다.

요약: 262K context에서 평균 107.54 t/s (10 clean runs, range 101.70-119.38) at FULL 262K context. Zero CUDA OOM( Out-of-Memory, GPU VRAM 부족으로 모델 실행이 실패하는 현상 없음). Zero degradation cycle (반복 테스트에서의 성능 저하 사이클이 발생 없음)

보다 자세한 성능 시험 결과는 출처에서 확인해 보시기 바랍니다.

TextWeb: LLM용 Markdown Browser

AI Agent가 웹 검색을 통해 자료를 수집할 때, 스크린샷 > Vison 모델 > Text 변환하는 방식이었다면 TextWeb은 Markdown으로 바로 렌더링해 주어서 LLM이 추론하는데 쉽게 사용할 수 있도록 해 주는 도구입니다. 다른 Headless browser들과의 차별성이 있을지 모르겠지만 혹 이런 Browser를 필요로 하시는 분들도 있을지 몰라서 소개합니다.

기능 및 특징:

- 전체 자바스크립트 실행 지원 (동적 페이지 처리 가능).

- 상호작용 요소(입력 필드, 버튼 등)를 주석으로 표시하여 LLM이 네이티브로 조작·추론 가능.

- 명령줄 인터페이스(CLI)와 MCP 서버 제공.

- LLM 에이전트가 페이지를 탐색, 스크롤, 텍스트 입력, 버튼 클릭 등을 수행할 수 있게 함.

- llama.cpp 웹 UI와 호환.

※ 지난 게시글:

- AI & OpenClaw – 2026.5.14 소식

- AI & OpenClaw – 2026.5.13 소식

- AI & OpenClaw – 2026.5.12 소식

- AI & OpenClaw – 2026.5.11 소식

- AI & OpenClaw – 2026.5.6 소식

※ 출처: r/LocalLLM, r/openclaw, r/unsloth, r/opencode, r/claude